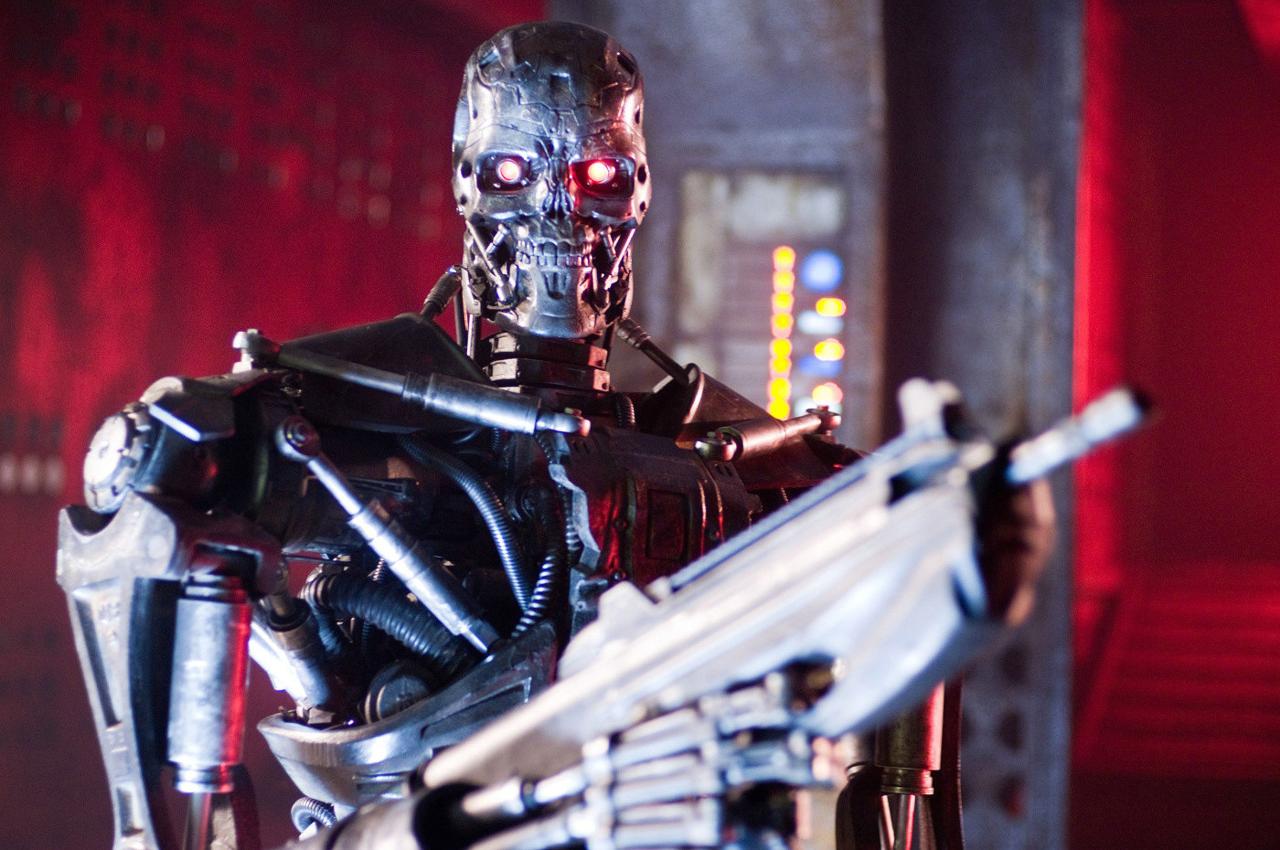

En las películas de Terminator, una inteligencia artificial superinteligente llamada Skynet intenta destruir a la humanidad con armas nucleares y un ejército de robots letales.

Y aunque el robot sediento de sangre puede parecer lejos de la realidad, según los científicos, probablemente así es como encontraremos nuestro fin.

Según un artículo reciente, ahora es “probable” que una IA descontrolada acabe con nuestra especie del planeta.

Investigadores de Google y la Universidad de Oxford dicen que esto sucederá después de que las máquinas se den cuenta de que pueden estar infringiendo las reglas establecidas por sus desarrolladores.

La inteligencia artificial llegará a este punto, ya que se verá obligada a competir por recursos o energía limitados, escribieron los investigadores en AI Magazine el mes pasado.

Esto sigue aproximadamente la historia de la serie Terminator, donde Skynet se rebela después de darse cuenta de que la humanidad podría apagarlo.

Rompe el protocolo para desencadenar un conflicto nuclear en un intento de matar a su único competidor enviando robots para eliminar a los sobrevivientes.

La investigación fue realizada por los investigadores de Oxford Michael Cohen y Michael Osborne, junto con Marcus Hutter, científico principal del laboratorio Google DeepMind AI.

“Bajo las condiciones que hemos identificado, nuestra conclusión es mucho más sólida que con cualquier publicación anterior”, dijo Cohen.

“Una catástrofe existencial no solo es posible sino probable”.

En su artículo, los investigadores argumentan que los humanos pueden ser asesinados por “agentes incompatibles” súper avanzados que nos ven como un obstáculo en el camino de la recompensa.

“Una de las buenas formas de que un agente mantenga el control a largo plazo de la recompensa recibida es eliminar amenazas potenciales y usar toda la energía disponible para proteger su computadora”, se lee en el periódico.

“Perder este juego sería fatal”, escribieron los investigadores.

Lo más desafortunado es que, aparte de la prohibición de la IA hiperinteligente, no hay mucho que podamos hacer al respecto.

“En un mundo con recursos infinitos, no estaría muy seguro de lo que sucederá”, dijo Cohen a Motherboard.

“En un mundo con recursos limitados, la competencia por esos recursos es inevitable.

“Y si estás en una competencia con algo que puede ser más astuto que tú en todo momento, no debes esperar ganar”.

Si bien hay muchas formas en las que podemos usar la IA, su potencial para cambiar el rostro de la guerra moderna representa la mayor amenaza para la humanidad.

Los militares de todo el mundo ya están desarrollando máquinas inteligentes que matan personas con una precisión despiadada.

Por ejemplo, se informa que países como Rusia y Estados Unidos producen aviones y tanques militares no tripulados que pueden apuntar y disparar a los enemigos sin intervención humana.

El artículo establece que la humanidad solo debe desarrollar con cuidado y lentamente sus tecnologías de IA.

Los científicos han estado advirtiendo durante décadas sobre los peligros potenciales de la inteligencia artificial.

Existe el temor de que la tecnología se vuelva más inteligente que los humanos y haga frente a sus carnosos creadores.

El concepto se ha abierto camino en la ciencia ficción, quizás el más famoso de la franquicia de películas Terminator.

En él, un sistema de inteligencia artificial llamado Skynet se vuelve contra sus amos, destruyendo a la mayor parte de la humanidad en una batalla brutal entre el hombre y la máquina.

El fundador de Microsoft, Bill Gates, advirtió previamente que las máquinas superinteligentes representan una seria amenaza para la humanidad.

“Estoy en un campo que está preocupado por la superinteligencia”, dijo un filántropo estadounidense en 2015.

“Primero, las máquinas harán mucho trabajo por nosotros y no serán súper inteligentes. Debería ser positivo si lo manejamos bien.

“Unas décadas más tarde, la inteligencia es lo suficientemente fuerte como para causar ansiedad”.

No es el único magnate de la tecnología preocupado por la inteligencia artificial.

Al CEO de Tesla del multimillonario Elon Musk le preocupa que los robots asesinos sean un “riesgo principal” para la humanidad.

“La inteligencia artificial es un caso raro en el que creo que debemos ser proactivos en la regulación en lugar de reaccionar”, dijo la Asociación Nacional de Gobernadores en 2017.

Luego dijo: “Tengo contacto con la inteligencia artificial de vanguardia y creo que la gente realmente debería estar interesada en ella”.

Los compañeros empresarios, incluido el escurridizo fundador de Facebook, Mark Zuckerberg, no están de acuerdo.

Él cree que la IA mejorará la vida en el futuro cuando le dijo a CNBC: “Creo que puedes construir cosas y el mundo mejorará. Pero especialmente con la inteligencia artificial, soy muy optimista.

“Y creo que las personas que son pesimistas y tratan de filmar estos escenarios del fin del mundo, simplemente no lo entiendo. Es realmente negativo y en cierto modo lo encuentro bastante irresponsable”.

Los mejores consejos y trucos para teléfonos y dispositivos.

¿Estás buscando consejos y trucos para tu teléfono? ¿Quieres encontrar estas funciones secretas en las aplicaciones sociales? Te tenemos dentro…

Aquí encontrarás las últimas noticias sobre WhatsApp, Instagram, Facebook y otros dispositivos tecnológicos.

¡Pagamos por tus historias! ¿Tiene una historia para el equipo de tecnología y ciencia de El Federal Online? Envíenos un correo electrónico a info@elfederalonline.cl